InternLM2.5-7B-Chat

70亿参数的高性能对话模型

- 在数学推理方面表现优异,超越同量级模型。

- 支持1M超长上下文窗口,适合长文本处理。

- 能够从多个网页搜集信息进行分析推理。

- 具备指令理解、工具筛选与结果反思等能力。

- 支持通过LMDeploy和vLLM进行模型部署和API服务。

- 代码遵循Apache-2.0协议开源,模型权重对学术研究完全开放。

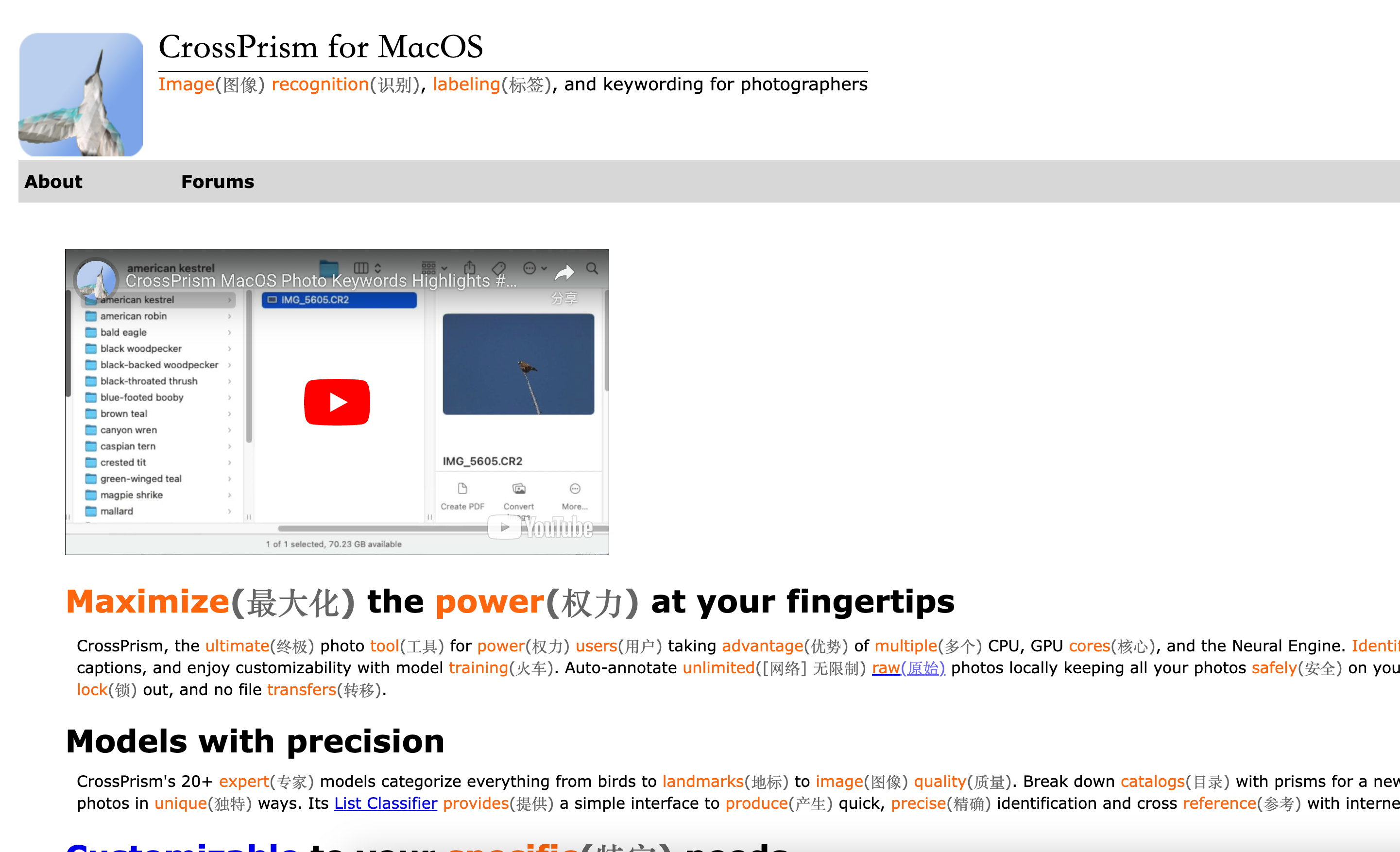

产品详情

InternLM2.5-7B-Chat是一个开源的7亿参数的中文对话模型,专为实用场景设计,具有卓越的推理能力,在数学推理方面超越了Llama3和Gemma2-9B等模型。支持从上百个网页搜集信息进行分析推理,具有强大的工具调用能力,支持1M超长上下文窗口,适合进行长文本处理和复杂任务的智能体构建。