FunAudioLLM

自然交互的语音理解和生成基础模型

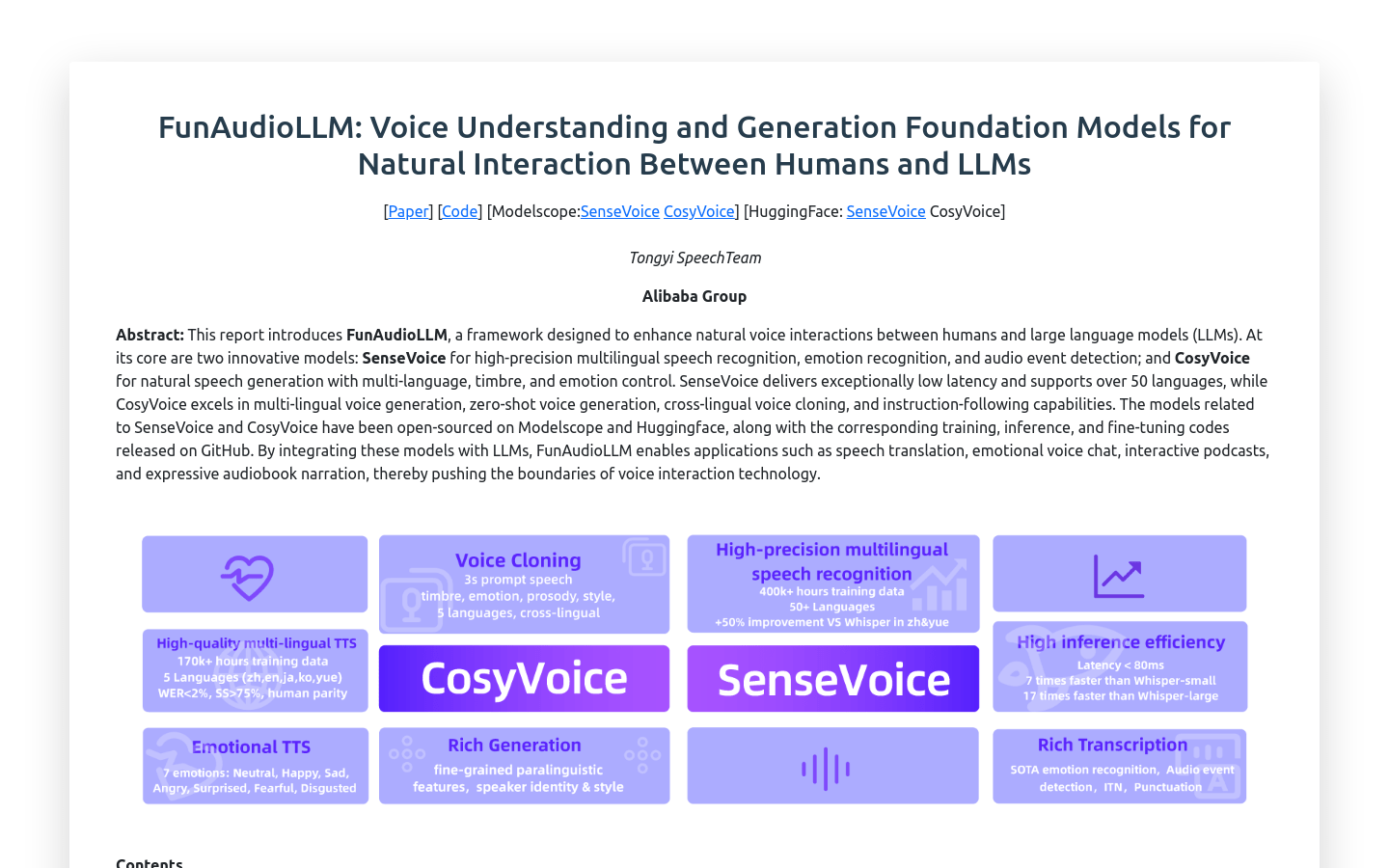

- 高精度多语种语音识别:支持超过50种语言的语音识别,具有极低延迟。

- 情绪识别:能够识别语音中的情绪,增强交互体验。

- 音频事件检测:识别音频中的特定事件,如音乐、掌声、笑声等。

- 自然语音生成:CosyVoice模型可以生成具有自然流畅度和多语种支持的语音。

- 零样本上下文生成:无需额外训练即可生成特定上下文的语音。

- 跨语言语音克隆:能够复制不同语言的语音风格。

- 指令跟随能力:根据用户的指令生成相应风格的语音。

产品详情

FunAudioLLM是一个旨在增强人类与大型语言模型(Large Language Models, LLMs)之间自然语音交互的框架。它包含两个创新模型:SenseVoice负责高精度多语种语音识别、情绪识别和音频事件检测;CosyVoice负责自然语音生成,支持多语种、音色和情绪控制。SenseVoice支持超过50种语言,具有极低的延迟;CosyVoice擅长多语种语音生成、零样本上下文生成、跨语言语音克隆和指令跟随能力。相关模型已在Modelscope和Huggingface上开源,并在GitHub上发布了相应的训练、推理和微调代码。