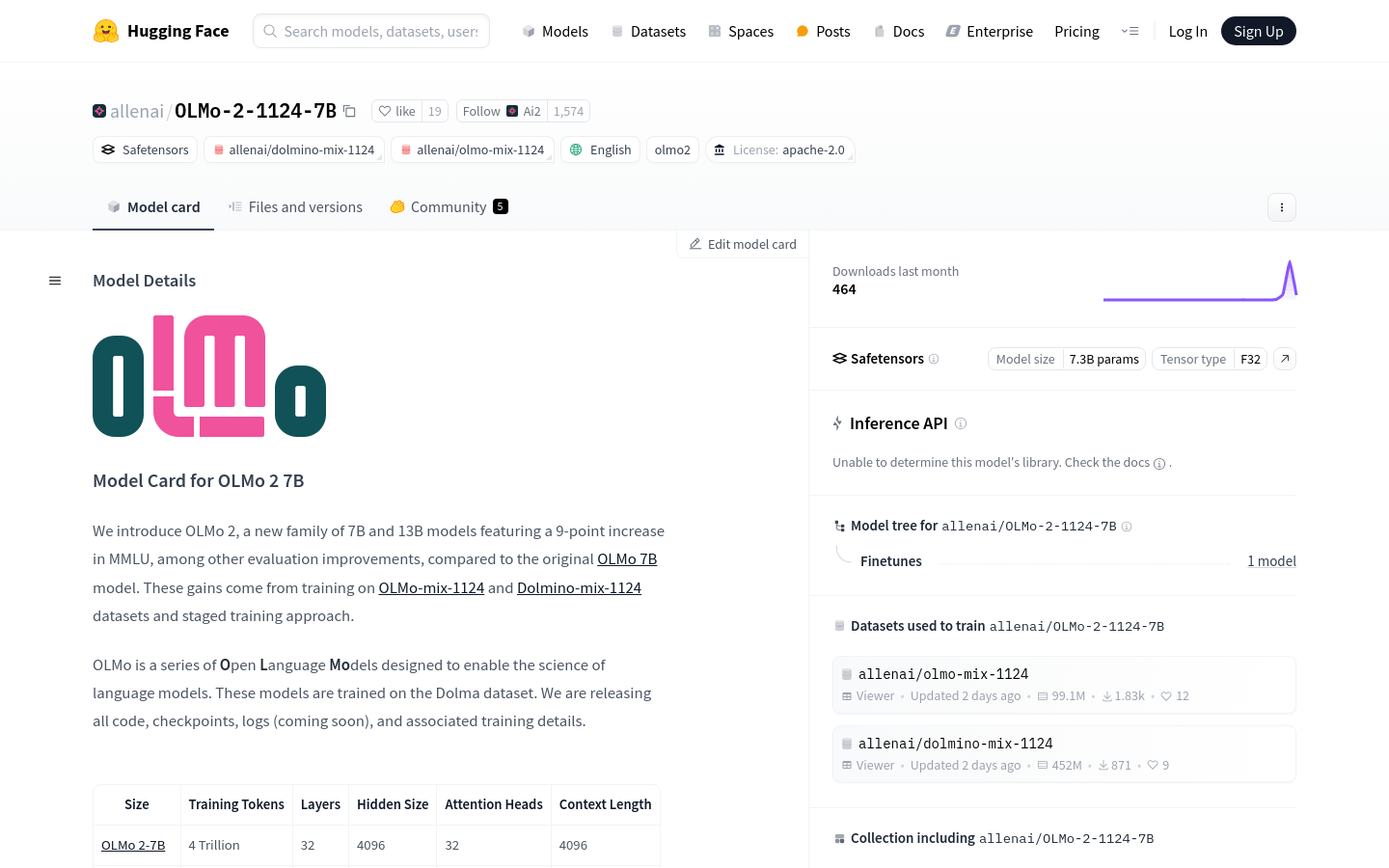

OLMo 2 7B

7B参数的大型语言模型,提升自然语言处理能力

0

- 支持多种自然语言处理任务,如文本生成、问答、文本分类等

- 在大规模数据集上训练,具有强大的语言理解和生成能力

- 开源模型,便于科研人员和开发者进行二次开发和微调

- 提供预训练模型和微调模型,满足不同应用场景的需求

- 支持使用Hugging Face的Transformers库进行模型加载和使用

- 模型量化支持,提高模型在硬件上的运行效率

- 提供详细的模型使用文档和社区支持,便于用户学习和交流

产品详情

OLMo 2 7B是由Allen Institute for AI (Ai2)开发的一款7B参数的大型语言模型,它在多个自然语言处理任务上展现出色的表现。该模型通过在大规模数据集上的训练,能够理解和生成自然语言,支持多种语言模型相关的科研和应用。OLMo 2 7B的主要优点包括其大规模的参数量,使得模型能够捕捉到更加细微的语言特征,以及其开源的特性,促进了学术界和工业界的进一步研究和应用。