MusiConGen

基于Transformer的文本到音乐生成模型

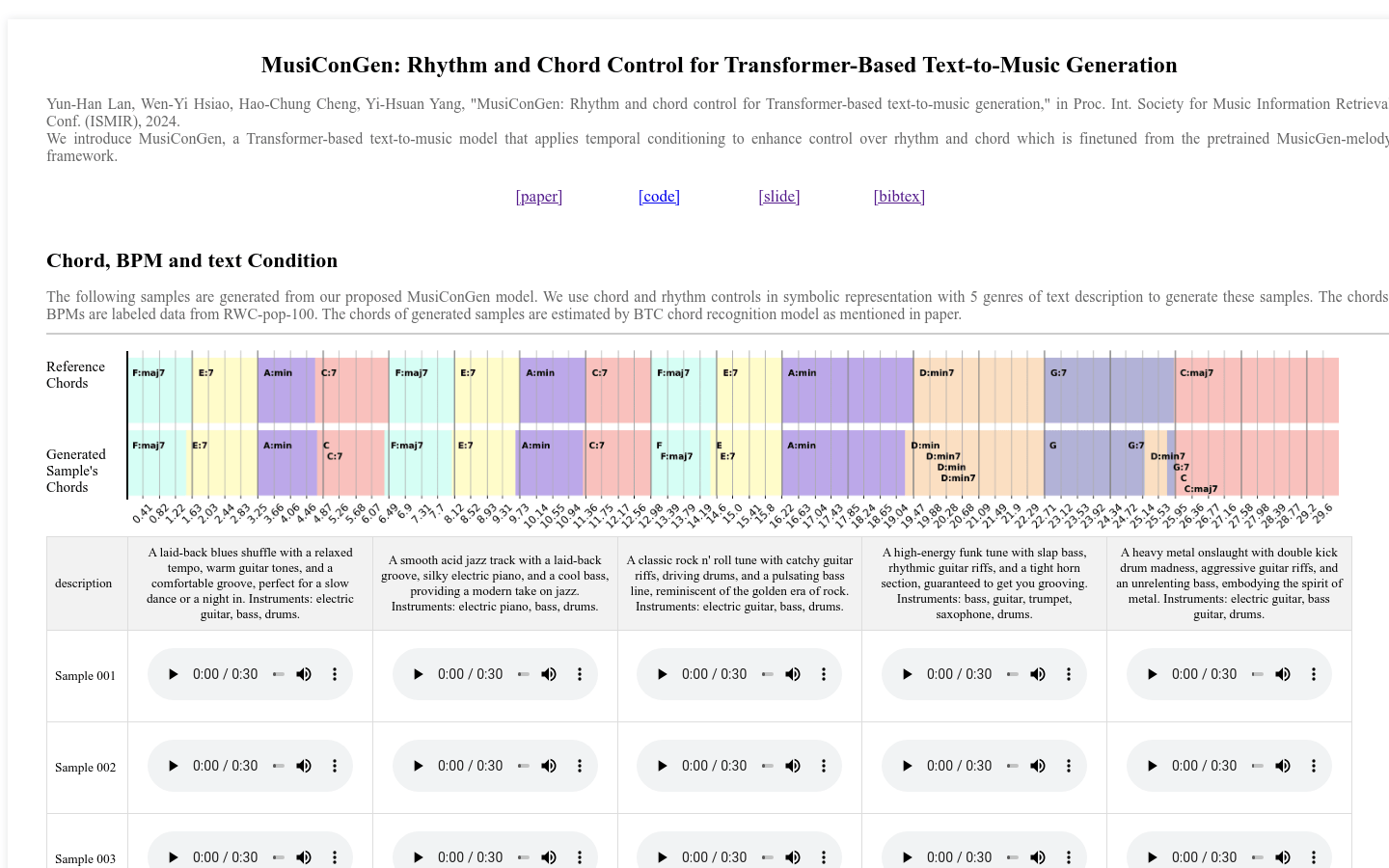

- 支持文本描述生成音乐样本

- 使用符号表示的和弦和节奏控制

- 结合多种文本描述风格生成音乐

- 通过BTC和弦识别模型估计生成样本的和弦

- 提供不同音乐风格(如蓝调、爵士、摇滚、放克、重金属)的样本

- 支持比较不同微调方法的性能

产品详情

MusiConGen是一个基于Transformer的文本到音乐生成模型,它通过时间条件增强对节奏和和弦的控制。该模型从预训练的MusicGen-melody框架中微调而来。它使用符号表示的和弦和节奏控制,并结合五种不同风格的文本描述来生成样本。生成样本的和弦通过BTC和弦识别模型进行估计,如论文中所述。